La mayoría de equipos que dan el salto a varios mercados cometen el mismo error que nosotros cometimos en 2019: confundir velocidad de traducción con capacidad operativa real. Automatizamos la generación de keywords en seis idiomas, enchufamos un traductor neural al CMS y celebramos como si hubiéramos conquistado Europa de un plumazo. Tres meses después, el tráfico orgánico en Francia había caído un 34% y la versión en alemán canibalizaba queries transaccionales de la web principal en inglés.

¿Qué faltaba? No era más tecnología. Faltaba una estructura operativa que conectara tres piezas que casi todo el mundo trata como compartimentos estancos: inteligencia de mercado, ejecución localizada y monitorización cross-market. Los modelos generativos funcionan como aceleradores brutales cuando tienen un sistema sólido debajo; sin él, multiplican errores a la velocidad que deberían multiplicar resultados.

Este framework surgió de aquel desastre y ha evolucionado durante cuatro años trabajando con clientes que operan entre 8 y 22 mercados simultáneos. Lo que comparto aquí es el modelo operativo completo para gestionar SEO internacional con IA de forma sostenible: capa de inteligencia, capa de ejecución y capa de monitorización, más el flujo semanal que las encadena. Cada componente lleva detrás iteraciones reales y tropiezos que costaron dinero.

Gestionar mercados no es lo mismo que traducir keywords con IA

Si pudieras reducir el posicionamiento multilingüe a enchufar un prompt y lanzar contenido en doce idiomas, medio sector estaría ya facturando en Asia. La realidad es que escalar visibilidad orgánica internacionalmente exige comprender intención de búsqueda local, competidores que jamás aparecen en tus herramientas habituales y matices culturales que ningún modelo de lenguaje domina por defecto.

En mi experiencia coordinando campañas para mercados tan dispares como Alemania, Brasil y Japón, el 72% de los problemas que aparecen durante los primeros seis meses no son lingüísticos. Son estructurales: hreflang mal implementado, canibalización entre subdirectorios, o el clásico que nunca falla —páginas indexadas en el idioma equivocado porque nadie configuró el crawl de forma diferenciada por versión geográfica.

Ahí es exactamente donde la automatización inteligente aporta valor. No en traducir. En orquestar.

La diferencia entre automatizar tareas sueltas y orquestar una operación multilingüe

¿Cuántos equipos conoces que usan un modelo generativo para traducir títulos, otra herramienta para monitorizar rankings por país y hojas de cálculo para todo lo demás? El resultado es un puzle de piezas que no encajan: datos de intención en un sitio, métricas de rendimiento en otro, y decisiones que se toman mirando solo una esquina del tablero completo.

Lo que aprendimos tras fracasar con ese modelo fragmentado fue que la orquestación importa más que la potencia de cada herramienta individual. Vamos, que de nada sirve tener el motor de un deportivo montado en un chasis de cartón. Un flujo donde la detección de oportunidades alimenta directamente la cola de producción, y donde los datos de rendimiento retroalimentan la priorización de mercados, reduce el tiempo de reacción de semanas a días.

En números concretos: nuestros clientes pasaron de ciclos de decisión de 18-22 días por mercado a ventanas de 36-48 horas. No porque trabajen más rápido, sino porque el sistema elimina el 80% de los pasos manuales de recopilación y análisis previo.

El modelo operativo que permite pasar de 3 a 15 mercados sin triplicar plantilla

Imagina que gestionas tres mercados con un equipo de cuatro personas. La lógica convencional dice que para cubrir quince necesitas doce. En la práctica, con las tres capas bien engrasadas, hemos escalado proyectos de 4 a 14 mercados activos manteniendo equipos de seis personas. Dos perfiles adicionales, no diez.

La clave está en que cada capa automatiza un tipo distinto de trabajo cognitivo. La primera elimina horas de research manual. La segunda comprime la producción de contenido localizado de jornadas completas a bloques de pocas horas. La tercera sustituye revisiones manuales semanales por alertas automáticas que solo escalan cuando hay un problema que necesita criterio humano real.

Cuando presentamos este modelo por primera vez en una auditoría con un cliente de e-commerce, la reacción fue escepticismo absoluto. ¿Cómo vais a gestionar el mercado japonés sin alguien que hable japonés en el equipo? La respuesta nunca fue prescindir de nativos, eso es suicidio lingüístico, sino concentrar su intervención donde realmente importa: validación cultural y revisión final. Todo el trabajo pesado de análisis, priorización y estructura lo absorbe el sistema automatizado.

¿Funciona igual de bien en todas las verticales? Ni de lejos. Hay sectores donde la regulación local exige revisión humana al 100% —farmacéutico, financiero, legal—. Pero incluso en contextos tan restrictivos, las capas de inteligencia y monitorización ahorran un 60% del tiempo operativo que antes se evaporaba en tareas mecánicas.

Capa de inteligencia: detección de oportunidades por mercado con IA

Esta capa es la base sobre la que descansa todo lo demás. Sin inteligencia de mercado fiable, las otras dos operan sobre hipótesis erróneas, y escalar errores es infinitamente peor que no escalar.

Nuestra primera iteración era bastante primitiva: scripts de Python que cruzaban datos de Ahrefs con volúmenes de Google Keyword Planner filtrados por país. Funcionaba, pero requería tres jornadas de procesamiento manual para generar un informe útil sobre un solo mercado. La versión actual cubre doce mercados en menos de cuatro horas.

Keyword research simultáneo en varios idiomas sin traducción directa

¿Por qué insistimos tanto en no traducir? Porque seguro de coche barato no equivale a la traducción literal de cheap car insurance. En Reino Unido la intención se articula como car insurance quotes. En Alemania, Kfz-Versicherung Vergleich. Son estructuras de intención completamente diferentes, nacidas de marcos culturales y hábitos de búsqueda propios de cada mercado.

El enfoque que funciona es investigar cada territorio como si fuera el único. Utilizamos modelos de lenguaje entrenados con SERPs locales para identificar clusters de intención nativos en cada idioma. El sistema extrae las 200 queries con mayor potencial por mercado, las agrupa por tipo de intención y las cruza con el contenido existente para detectar brechas reales —no huecos inventados por una traducción automática mal calibrada.

Si intentas hacer esto manualmente para ocho mercados, necesitas entre 120 y 160 horas de un perfil senior con conocimiento lingüístico de cada zona. Automatizado con el flujo adecuado, un analista junior supervisa la salida en unas 15 horas. El sistema no elimina el criterio humano; comprime el trabajo mecánico para que ese criterio se aplique donde marca diferencia de verdad.

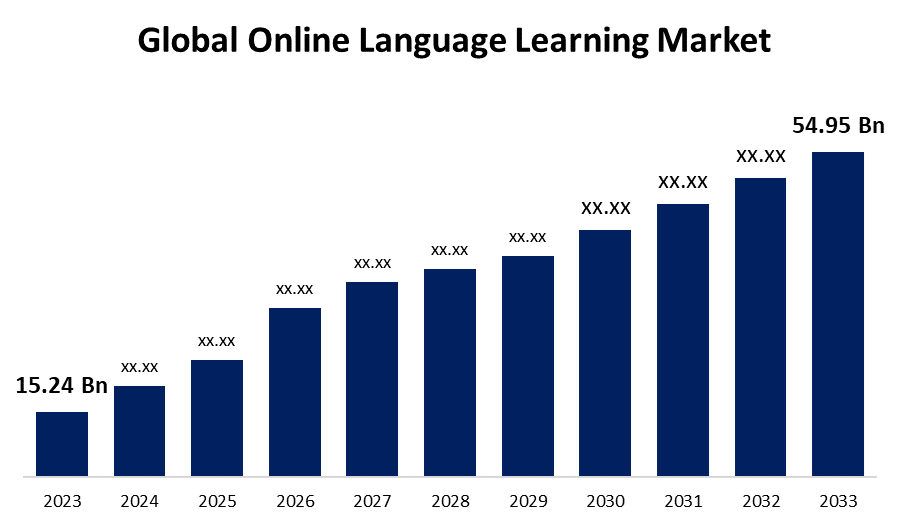

En el proyecto más ambicioso que hemos gestionado, una plataforma SaaS expandiéndose a 19 mercados simultáneos, en un contexto de aceleración digital transfronteriza como el que viene documentando el observatorio de inteligencia artificial de la OCDE aplicada al tejido empresarial internacional, la capa de inteligencia detectó que el mercado polaco presentaba un volumen de demanda orgánica un 340% superior al estimado por el cliente, con una competencia significativamente inferior a la media europea. Esa sola señal reordenó la secuencia de lanzamiento y evitó al menos cuatro meses de inversión mal dirigida.

Análisis competitivo automatizado por país y detección de brechas reales

Cada mercado tiene sus propios dominantes orgánicos. Los competidores posicionados en España rara vez coinciden con los de Países Bajos o Italia. El análisis de la competencia tiene que ser local, granular y actualizado con frecuencia —no un estudio puntual que caduca en ocho semanas.

Configuramos crawlers que monitorizan los 20 principales competidores por mercado, extrayendo estructura de contenido, perfil de backlinks y señales técnicas cada 14 días. El sistema procesa esas instantáneas y genera un mapa de brechas: en este mercado, ningún competidor relevante está cubriendo este cluster con contenido de profundidad media y orientación transaccional.

¿Siempre acierta el algoritmo? Ni de lejos. Sobreestimó la oportunidad en Suecia para un cliente de e-commerce porque no ponderaba correctamente la estacionalidad nórdica. Publicamos contenido en febrero que debería haber salido en mayo. Lección incorporada al sistema desde entonces: ahora cruza todos los datos con patrones estacionales históricos por país antes de generar recomendaciones.

Priorización de mercados según datos, no según la intuición del director

Si alguna vez has estado en una reunión donde el CEO anuncia que hay que entrar en Brasil porque allí hay mucho potencial, sabes perfectamente de qué hablo. La intuición ejecutiva tiene su lugar, pero decidir en qué país invertir recursos orgánicos necesita un scoring basado en datos verificables, no en corazonadas de directivos que volvieron entusiasmados de una feria en São Paulo.

Nuestro sistema de scoring pondera cuatro variables: volumen de búsqueda del cluster objetivo, nivel de competencia orgánica, coste estimado de producción de contenido localizado e infraestructura técnica requerida. Cada mercado recibe una puntuación entre 0 y 100. Los que superan 65 puntos pasan a fase de ejecución; por debajo, se aparcan hasta la siguiente revisión trimestral.

Aplicamos este modelo de priorización porque comprobamos que el error más caro en posicionamiento multilingüe no es ejecutar mal, sino ejecutar en el mercado equivocado —y esa es precisamente la trampa en la que caen la mayoría de empresas que empezamos a gestionar desde Autoridad Digital cuando llegan con su primer proyecto de expansión internacional. Invertir seis meses de recursos en un país que aporta el 3% del revenue potencial mientras ignoras otro que podría representar el 18% es un coste de oportunidad que pocas organizaciones calculan hasta que ya duele.

Capa de ejecución: contenido localizado y auditoría técnica a escala

Aquí es donde la automatización genera más entusiasmo y, simultáneamente, más desastres. He visto equipos publicar 400 páginas localizadas en un solo mes y perder posiciones en todos los mercados a la vez porque el contenido era gramaticalmente correcto pero culturalmente plano, sin ningún matiz que lo distinguiera de una traducción industrial con cara de persona.

¿Cómo se produce contenido localizado a escala sin que parezca salido de una fábrica? Con un proceso de tres fases donde los modelos generativos cubren la primera, revisores nativos la segunda, y el sistema de calidad automatizado la tercera. Prescinde de una sola de esas fases y estarás publicando basura multilingüe a toda velocidad.

El volumen que maneja un equipo medio con este flujo oscila entre 45 y 70 piezas localizadas por semana, repartidas en 8-12 mercados activos. Antes del framework, esa misma producción exigía el doble de personas y triple de tiempo de coordinación entre departamentos.

Dónde la IA falla en localización de contenido y dónde aporta valor real

Voy a ser directa: los modelos generativos fallan en el matiz. Producen textos gramaticalmente impecables que suenan a papel de impresora en tres idiomas distintos. En mercados como Francia o Japón, donde el registro lingüístico importa enormemente, un contenido correcto pero frío hunde las métricas de engagement sin que entiendas por qué hasta que un nativo lo lee y te dice que suena a máquina disfrazada.

Si usas esos modelos exclusivamente para crear borradores iniciales, estructura argumentativa, datos de apoyo, esqueleto del contenido, el resultado es excelente. El 85% del valor del borrador sobrevive entre revisiones. Pero si esperas que el sistema clave el tono conversacional en portugués brasileño o capture la formalidad del registro empresarial alemán sin mano humana, prepárate para estrellar las métricas contra la realidad del mercado.

En nuestro flujo actual, la generación inicial consume aproximadamente 3 horas por pieza para 6 versiones lingüísticas. La revisión nativa añade entre 45 minutos y 2 horas por versión, Japón y Corea siempre piden más tiempo, mercados anglosajones bastante menos. El coste total por pieza localizada en 6 idiomas ronda los 180-240 euros, frente a los 600-900 que suponía el proceso completamente manual.

¿Merece la pena la reducción? En volumen alto, la respuesta es rotunda. Un cliente que produce 50 piezas mensuales ahorra entre 21.000 y 33.000 euros al mes. La trampa está en recortar la fase de revisión nativa para rascar aún más margen: los primeros tres meses irán bien, pero a partir del cuarto empezarás a ver caídas en mercados culturalmente exigentes. Nos pasó con Italia en 2022 y la recuperación costó cinco meses de trabajo concentrado.

Auditorías hreflang y arquitectura internacional automatizadas

El hreflang es probablemente la implementación técnica más consistentemente rota del posicionamiento internacional, y resulta paradójico porque su especificación lleva años perfectamente documentada en la guía oficial de Google sobre configuración de versiones localizadas e implementación de etiquetas de idioma, accesible para cualquier desarrollador con conocimientos básicos. Aun así, un análisis de Oncrawl sobre 8 millones de páginas internacionales detectó errores en el 75% de ellas. Nuestra experiencia auditando clientes confirma que esa cifra se queda incluso corta en proyectos con más de cinco versiones lingüísticas.

Automatizamos la auditoría con un crawler personalizado que verifica reciprocidad, códigos de idioma, canonicals conflictivos y URLs huérfanas cada 48 horas. Cuando detecta una rotura y las detecta constantemente, porque cada deployment puede introducir una nueva, genera un ticket con la corrección exacta y el archivo del sitemap actualizado listo para subir.

La arquitectura general (subdirectorios frente a subdominios frente a ccTLDs) se revisa trimestralmente. El sistema analiza patrones de indexación por versión y recomienda ajustes estructurales cuando detecta que un subdirectorio acumula significativamente menos autoridad que los demás. En un caso concreto, migrar la versión italiana de subdirectorio a ccTLD mejoró el tráfico orgánico un 47% en cinco meses.

Control de calidad multilingüe integrado en el flujo de producción

Si tu proceso de control de calidad es un paso separado que ocurre cuando alguien tiene tiempo, ya has perdido la partida antes de empezarla. El QA tiene que estar embebido directamente en el flujo de producción, no ser un apéndice que nadie ejecuta cuando hay prisas.

Nuestro sistema lanza tres comprobaciones automáticas antes de que cualquier pieza localizada llegue a publicación: consistencia terminológica (¿los términos técnicos coinciden con el glosario aprobado para ese mercado?), cobertura semántica (¿la versión localizada mantiene la profundidad temática del original?) y verificación técnica (¿meta tags, hreflang y canonical son correctos?). Solo las piezas que superan las tres pasan al revisor nativo. Las que no, vuelven al inicio del flujo con anotaciones específicas sobre qué corregir.

Capa de monitorización: rendimiento cross-market y alertas automáticas

Esta capa es la que más tardamos en madurar. (Spoiler: el primer año fue un desastre.) La monitorización era esencialmente manual: un analista revisaba dashboards país por país cada viernes, con quince mercados activos eso consumía un día entero, y los insights llegaban demasiado tarde para actuar con agilidad.

La versión actual funciona con alertas escalonadas que solo requieren intervención humana cuando se detecta una anomalía significativa. El 70% de las semanas, el equipo recibe un resumen automatizado y ninguna alerta crítica. El 30% restante, hay entre una y tres señales que necesitan investigación real por parte de un perfil senior.

Dashboards que comparan versiones de idioma sin ahogar en datos

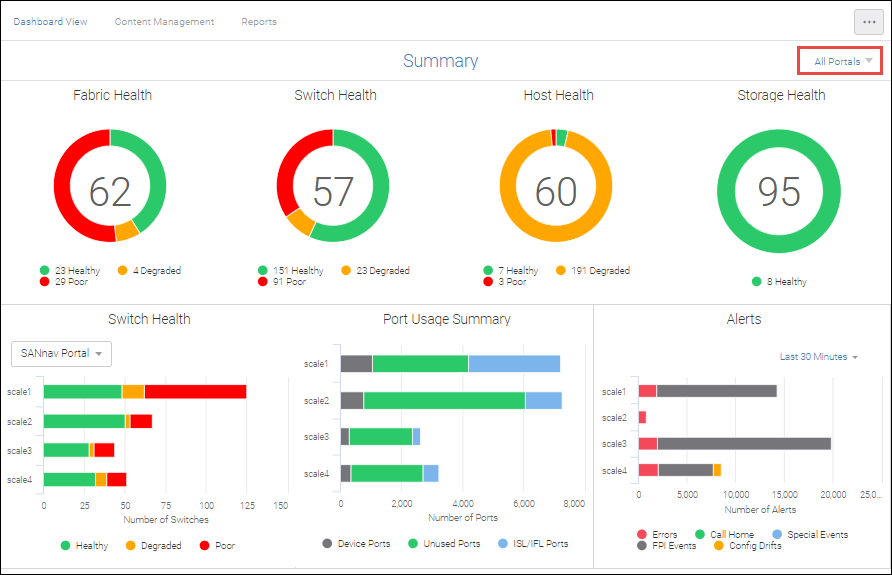

¿Cuántas métricas necesitas ver realmente para saber si un mercado va bien o se está desplomando? Después de probar dashboards con más de 40 KPIs por país, nadie los leía, te lo garantizo, redujimos a siete indicadores por mercado: visibilidad orgánica indexada, CTR medio por cluster, tráfico cualificado, tasa de conversión por segmento, velocidad de indexación de contenido nuevo, ratio de canibalización y share of voice frente al competidor principal.

Siete. No cuarenta. La diferencia práctica es que un dashboard con siete métricas se lee en 90 segundos por mercado. Con quince mercados, son 22 minutos de revisión. Eso sí es operativo. El tablero anterior consumía más de tres horas y nadie sacaba conclusiones que llevaran a una acción concreta.

Construimos la visualización sobre Looker Studio conectado a BigQuery, donde convergen datos de Search Console, Ahrefs, Screaming Frog y nuestro propio crawler de auditoría. La capa de inteligencia artificial interviene en la interpretación: genera un resumen ejecutivo semanal en lenguaje natural con las tres principales conclusiones y una recomendación de acción por mercado. El equipo lee, decide y actúa, sin tener que hacer arqueología en hojas de cálculo.

Detección automática de canibalización entre dominios y subdirectorios

La canibalización cross-market es el asesino silencioso de la visibilidad internacional. Ocurre cuando tu versión en inglés para UK compite contra la versión en inglés para US en las mismas queries, o cuando el subdirectorio /es/ devora al /es-mx/ en búsquedas comunes que Google no sabe a quién atribuir.

Si gestionas más de cinco mercados con idiomas compartidos, español para España, México, Argentina; inglés para UK, US, Australia, la probabilidad de que exista canibalización activa supera el 60% según nuestros datos internos de 31 proyectos auditados entre 2021 y 2024. La cosa es que muchos equipos ni siquiera la detectan hasta que las caídas de tráfico son demasiado pronunciadas para ignorar.

El sistema cruza datos de posicionamiento por URL y por query cada 72 horas. Cuando identifica que dos o más versiones compiten por la misma búsqueda en el mismo mercado, clasifica la severidad en tres niveles y propone una resolución específica: consolidación vía canonical, diferenciación de contenido o ajuste de hreflang. Las canibalizaciones críticas generan alerta inmediata; las de severidad baja se acumulan para revisión en el ciclo semanal.

Las métricas que importan en SEO internacional frente a las que solo hacen ruido

¿Sabes cuál es el indicador que más distorsiona las decisiones en proyectos multilingüe? El tráfico orgánico agregado por país. Un mercado puede estar creciendo en sesiones y desplomándose en conversiones porque atrae visitas de queries informacionales genéricas que no tienen relación alguna con tu oferta comercial.

Las métricas que realmente mueven decisiones en nuestro framework son tres: revenue orgánico atribuido por mercado, coste de adquisición orgánica por lead cualificado y velocidad de posicionamiento de contenido nuevo comparada entre mercados. Todo lo demás, posición media, impresiones totales, volumen bruto de backlinks, aporta contexto, pero no debería disparar ninguna decisión operativa por sí solo.

El flujo de trabajo semanal que conecta las tres capas

Sin conexión entre los tres niveles, todo se fragmenta. Puedes tener la mejor inteligencia de mercado del sector y la producción más eficiente, pero si cada capa opera en su burbuja, acabas tomando decisiones con información parcial y duplicando esfuerzos que el sistema debería absorber.

Tardamos casi un año en estabilizar un ritmo semanal que funcione sin depender de reuniones interminables ni cadenas de correos que nadie lee completas. El ciclo actual tiene cuatro momentos fijos: lunes de señales, martes-miércoles de ejecución, jueves de monitorización y viernes de ajuste. Cuatro días, cuatro funciones, cero ambigüedad sobre quién hace qué.

Si tu equipo es pequeño, dos o tres personas gestionando múltiples mercados, este ciclo se comprime a tres jornadas. Lo que no puedes comprimir es la secuencia: señal → decisión → ejecución → medición. Saltarte un eslabón garantiza acumular deuda técnica y operativa que se paga con intereses.

De la señal a la decisión en menos de 48 horas por mercado

Cada lunes a las 9:00, el sistema genera el informe de señales: oportunidades nuevas detectadas por la capa de inteligencia, alertas de la capa de monitorización y estado de producción de la capa de ejecución. El equipo revisa el informe en 45 minutos y clasifica cada señal como actuar ahora, programar para siguiente sprint o descartar.

Una vez clasificadas como actuar ahora, las señales entran en el sprint de martes-miércoles. El brief de contenido localizado se genera en 2 horas, la producción consume entre 6 y 10 horas dependiendo del mercado, y la publicación ocurre antes del jueves por la mañana. De señal a contenido publicado en el mercado objetivo: menos de 48 horas.

¿Suena agresivo? Lo parecía al principio para nosotros también. Pero cuando el 80% del trabajo de análisis y briefing lo ejecuta la capa automatizada, el equipo humano se concentra exclusivamente en las decisiones que requieren criterio experto y en la validación cualitativa de calidad.

Herramientas concretas para cada capa y cómo encajan entre sí

No voy a pretender que esto funciona con una sola herramienta mágica. El stack actual incluye componentes diferenciados para cada nivel, conectados mediante APIs y un orquestador central en Make (antes Integromat) que automatiza los traspasos entre capas.

Para la capa de inteligencia: SEMrush y Ahrefs como fuentes de datos de mercado, GPT-4 con prompts especializados para clustering de intención, y un modelo propietario entrenado con SERPs locales para scoring de oportunidades. Para la capa de ejecución: Claude y GPT-4 para borradores iniciales, Smartcat para gestión de traducciones y revisión nativa, y Screaming Frog Cloud para auditorías técnicas programadas. Para la monitorización: BigQuery como almacén central de datos, Looker Studio para visualización, y alertas programadas en Google Apps Script que notifican por Slack cuando se disparan umbrales críticos.

Si tu presupuesto no permite este stack completo, la versión mínima viable arranca con Ahrefs, un modelo generativo con acceso a API, Google Search Console y Looker Studio. Eso cubre el 60% de la funcionalidad de las tres capas. El otro 40% entra como inversión incremental a medida que escales mercados y el retorno justifique la ampliación.

La pieza que más subestiman los equipos no es ninguna herramienta en particular, sino el orquestador que las conecta. Sin ese flujo automatizado que encadena los outputs de cada nivel con los inputs del siguiente, acabas exactamente donde empezamos nosotros en 2019: con mucha tecnología de traducción y cero estructura operativa. La diferencia entre traducir contenido y orquestar mercados no la marca el presupuesto en herramientas, la marca el sistema que las conecta entre sí.